😱 Wir haben Copilot aktiviert und plötzlich war alles auffindbar

Viele Unternehmen behandeln Copilot wie einen Feature Schalter: Lizenz zuweisen, Copilot erscheint in Teams, Word, Outlook und los geht’s. Technisch klappt das oft schnell. Ob Copilot danach wirklich hilfreich ist oder plötzlich unangenehme Fragen auslöst, entscheidet aber eure Microsoft 365 Realität. 🧩

Copilot Startklarheit bedeutet nicht KI vorbereiten, sondern Datenzugriff und Datenqualität vorbereiten. ✅

Copilot arbeitet im Tenant Kontext und nutzt Inhalte aus Microsoft 365 über Microsoft Graph. Ergebnisse entstehen innerhalb der bestehenden Benutzerberechtigungen.

Das ist gut, weil es keine neuen Datenrechte schafft. Es ist riskant, weil historisch gewachsene Freigaben dadurch plötzlich spürbar werden. ⚠️

Warum Copilot so schnell Wirkung zeigt 🎯

Copilot verstärkt, was schon da ist.

Ordnung wird produktiver ✨

Unordnung wird sichtbarer 🔦

Oversharing wird einfacher auszunutzen 🚪

Datenmüll wird leichter gefunden 🗂️

Darum ist Copilot kein klassisches KI Projekt. Es ist ein Data Governance Projekt. 🏛️

1) Der Copilot Effekt: Berechtigungen werden zur ersten Priorität 👥

Copilot kann nur verwenden, was ein Nutzer ohnehin lesen darf. Genau deshalb ist Zugriffshygiene der wichtigste Startpunkt:

• Externe Freigaben und Gastzugriff prüfen 🌍

• Breite Gruppenberechtigungen in SharePoint und Teams identifizieren 🧭

• Owner und Verantwortlichkeiten sauber setzen 👤

• Verwaiste Sites und Teams schließen oder archivieren 🧹

• Kritische Bereiche gezielt härten 🛡️

Ein sehr pragmatischer Startschutz ist Restricted SharePoint Search. Damit könnt ihr Copilot und die organisationsweite Suche auf eine kuratierte Liste von SharePoint Sites begrenzen, bis Berechtigungen und Governance nachgezogen sind.

Dabei bleibt Arbeit in eigenen und bereits genutzten Inhalten weiterhin möglich. ✅

2) Datenqualität: Copilot ist nur so gut wie eure Informationsarchitektur 🧱

Copilot liefert bessere Ergebnisse, wenn eure Inhalte auffindbar und verständlich sind. Typische Bremsen, die fast überall auftauchen:

• Mehrfachablagen und veraltete Versionen ♻️

• Unklare Dokumenttitel, fehlende Standards, keine eindeutige Quelle 🧾

• Teams und Sites ohne Lebenszyklus ⏳

• Inhalte, die fachlich überholt sind, aber weiter existieren 🕰️

Das ist kein Copilot Problem. Copilot macht es nur schneller sichtbar. 👀

3) Microsoft Purview: Aus Bauchgefühl wird Steuerung 🎛️

Wenn Copilot Startklarheit ein Datenprojekt ist, ist Purview das Werkzeug, um es sauber zu steuern. 🔍

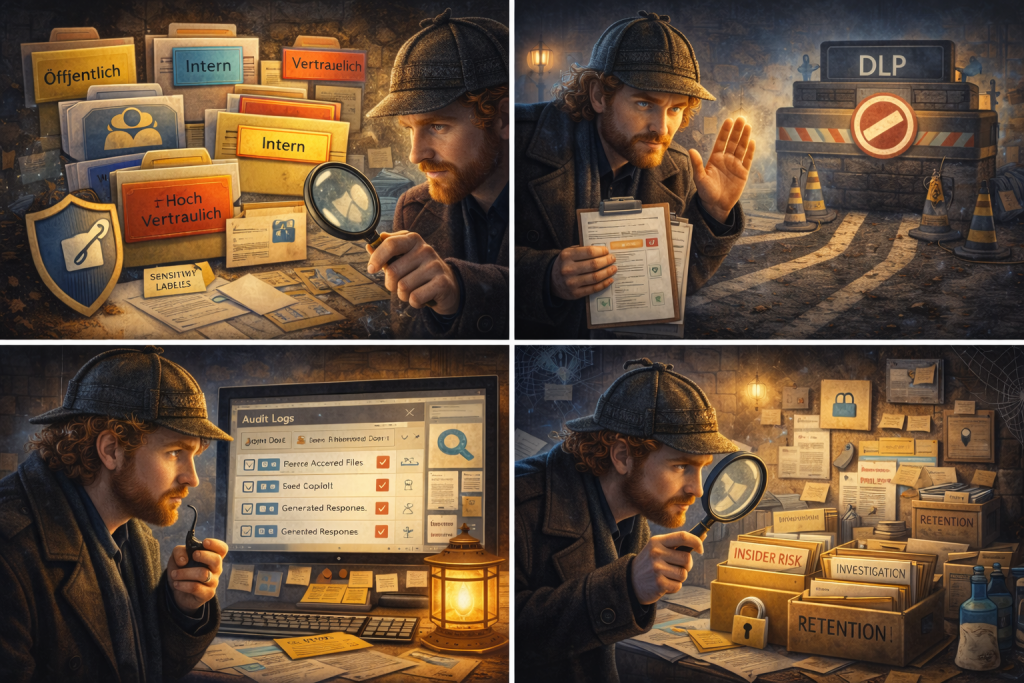

Sensitivity Labels als gemeinsame Sprache 🏷️

Labels schaffen Klarheit, welche Inhalte sensibel sind und wie sie behandelt werden sollen. Praktisch heißt das:

• Verständliche Label Taxonomie, die Anwender akzeptieren 🙂

• Klare Regeln, wann Labels Pflicht sind 📌

• Auto Labeling dort, wo Datenmuster stabil sind 🤖

• Verschlüsselung nur dort, wo Prozesse sie tragen 🔒

Das Ziel ist nicht maximale Komplexität, sondern verlässliche Einordnung. ✅

DLP als Leitplanken statt Vollbremsung 🚧

Für Copilot braucht ihr DLP nicht als Block Everything, sondern als Kontrollrahmen:

• Sensible Inhalte dürfen nicht unkontrolliert geteilt werden 🚫

• Riskante Aktionen sollen verhindert oder begründet werden 🧾

• Ausnahmen müssen nachvollziehbar sein 🧠

Damit schützt ihr Informationen, ohne Produktivität abzuwürgen. ⚖️

Audit: Nachvollziehbarkeit gehört zum Copilot Betrieb 🧾

Copilot Nutzung wirft im Alltag neue Fragen auf: Wer hat was genutzt, in welchem Kontext, mit welchen Daten. Microsoft Purview Audit erzeugt Protokolle zu Copilot Interaktionen, und wenn Auditing aktiviert ist, sind keine Extra Schritte nötig, um Copilot Audit Support zu konfigurieren.

Audit Records können außerdem referenzieren, welche Ressourcen Copilot zur Beantwortung genutzt hat, inklusive Sensitivity Label Bezug. 🔎

Insider Risk, eDiscovery, Retention: Der Betrieb entscheidet 🧰

Spätestens wenn ein Vorfall passiert, zählt nicht die Demo, sondern der Prozess:

• Insider Risk Management, um riskantes Verhalten früh zu erkennen 🚨

• eDiscovery, um Untersuchungen strukturiert durchzuführen 🕵️

• Retention, um Altlasten zu reduzieren und Pflichten sauber einzuhalten 🗃️

Retention ist dabei ein unterschätzter Qualitätshebel: Wenn alles ewig bleibt, bleibt auch jede Altlast dauerhaft auffindbar. 📎

4) Datenschutz: Ein Satz, den ihr intern sauber erklären können müsst 🧑⚖️

Für viele Freigaben ist entscheidend, wie Prompts und Antworten behandelt werden. Microsoft beschreibt unter Enterprise Data Protection, dass Prompts, Antworten und Daten, auf die über Microsoft Graph zugegriffen wird, nicht zum Training von Foundation Models genutzt werden.

Das ersetzt keine eigene Risikoanalyse, ist aber ein wichtiger Baustein für Datenschutz, Betriebsrat und Compliance Kommunikation. ✅

5) Ein pragmatischer Startklar Plan 🗺️

Schritt 1: Suchraum kontrollieren und Hotspots finden 🔥

• Oversharing Hotspots identifizieren 🧯

• Optional Restricted SharePoint Search als Startschutz nutzen ✅

Schritt 2: Schutzlogik sauber ziehen 🧩

• Label Taxonomie konsolidieren 🏷️

• DLP Leitplanken nach Schutzbedarf 🚧

• Ausnahmen und Prozesse definieren 📘

Schritt 3: Nachvollziehbarkeit und Reaktion absichern 🛠️

• Audit Nutzung für Copilot etablieren 🧾

• Insider Risk und Investigation Abläufe definieren 🕵️

• Retention und Lifecycle konsequent umsetzen 🗃️

Fazit 💡

Copilot ist kein reines Lizenzthema. Der echte Erfolg entsteht, wenn ihr Datenzugriff und Datenqualität in Ordnung bringt und Purview als Steuerungs und Kontrollrahmen nutzt. Dann wird Copilot schnell wertvoll. Ohne diese Vorarbeit verstärkt Copilot vor allem das, was im Tenant ohnehin schon schief hängt. ⚠️✅

Schreibe einen Kommentar